5e partie – Timeline du show control

Répondant initialement aux besoins de l’univers du tournage, les utilisations du time code se sont peu à peu étendues à de multiples environnements, dès lors que la notion de synchronisation apparaît. Entre image et son mais aussi lumière, scénographie et machinerie, effets spéciaux, pyrotechnie… le time code est la colonne vertébrale temporelle du show control tel qu’on le trouve dans de nombreux événements et spectacles.

L’utilisation du time code pour commander des événements a débuté en 1988. Les échantillons contenus dans le sampler Akaï S1000 pouvaient être lancés sur des adresses de MTC (MIDI Time Code). Dès 1992, le pupitre MA Lighting Scancommander dispose d’entrées de contrôle MIDI et SMPTE. En 1993, le MIDI Time Code issu d’un clavier maître assure le lancement d’images et d’effets sur le spectacle Sunset Boulevard à l’Adelphi Theatre. En 1994, la mise à jour Wholehog 1.10, associée à une entrée physique, permet au pupitre de recevoir du MIDI et du SMPTE de cue.

Le terme show control semble apparaître quant à lui au début des années 1990, à l’occasion de la création du protocole MSC (MIDI Show Control), qui utilise le codage MIDI pour transmettre des informations et commandes entre tous types d’équipements multimédia. Entendons-nous bien, le MSC ne transmet aucune donnée des média, uniquement des informations numériques sur les événements. Le protocole MSC est ratifié en 1991.

Le protocole OSC (Open Sound Control) est aussi l’un des langages fréquemment rencontrés en show control. Il utilise les protocoles UDP et TCP et apporte une alternative intéressante à l’usage du MSC en termes de rapidité et flexibilité. L’implémentation OSC est rencontrée dans de multiples applications utilisées en spectacle et événementiel. Et il existe une offre importante d’interfaces de commande des paramètres, sous forme physique ou via écran tactile.

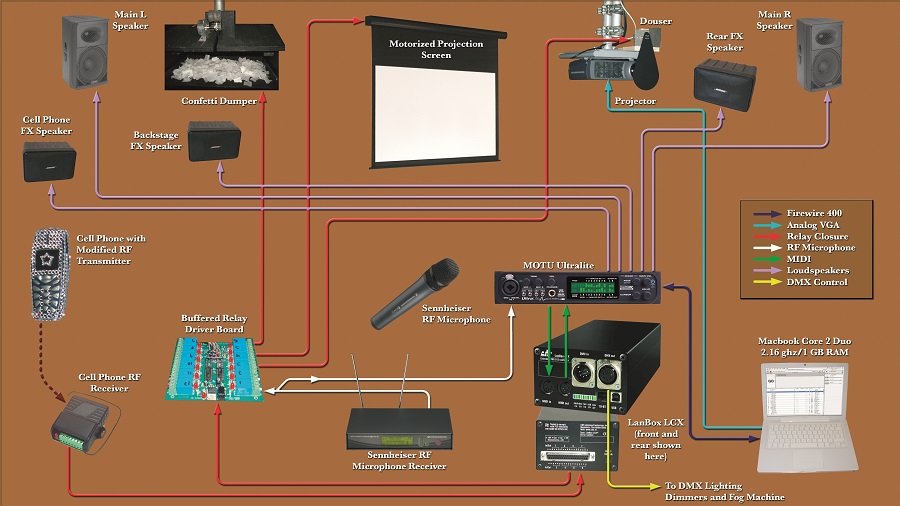

Quel que soit le protocole et les domaines d’application, le principe de fonctionnement reste toujours le même :

synchroniser des cues de commande sur une timeline asservie à un time code.

Exemples d’applications

Citons de prime abord les spectacles, dont certains sont time codés du début à la fin, pour par exemple lancer un clic et des playbacks issus de séquenceurs, les séquences vidéo de média servers destinées aux écrans, les snapshots des consoles de mixage, les programmes des traitements audio, le déclenchement d’effets pyrotechniques ou cinétiques…

En muséographie également, pour le déroulement des présentations interactives, des animations ou des scénographies impliquant différents sens.

Au cinéma, les simples besoins de synchro image et son sont aujourd’hui transcendés. Dans les salles 4DX, ce sont les vérins hydrauliques des sièges, les effets lumineux, la génération de brouillard, les sources olfactives, les projections d’eau… qu’il faut également caler ensemble.

Dans certains parcs de loisirs, les spectacles font désormais intervenir de multiples technologies et machineries qu’il faut aussi synchroniser.

Show control total ou partiel ?

Un show peut être entièrement synchronisé, de sa première à sa dernière seconde. C’est le cas par exemple de l’Eurovision. Chacune des multiples répétitions se déroule sur une time line identique et répliquée à la fraction de seconde. Son, lumière, vidéo et effets, mais aussi déplacement des techniciens et des artistes, mouvements des cadreurs et des caméras, réactions du public, intervention des animateurs… tout ce qui se passe au fil des heures du spectacle est synchronisé sur le time code. Soit par déclenchements automatiques programmés à l’avance, soit sous les ordres de topeurs, souvent des topeuses d’ailleurs, qui communiquent en permanence via l’intercom avec les techniciens du plateau pour que tout se passe en temps et en heure suivant leur conducteur, lui aussi référencé sur le time code.